Cайт web archive org: как пользоваться посмотреть скачать details страниц статей интернета Вконтакте сохранить онлайн Веб архив

Сайт Web.archive.org — большущее хранилище и архив, в нем есть все когда-либо бывшие сайты в сети. Хранятся они не как картинки и фотки, ав работающем виде, с информацией, графикой, ссылками и многими другими атрибутами. Для каждого ресурса веб архив может хранить мноржество вариантов и копий сайта, они будеут содержать дату с определенного этапа функционирования сайта.

Будет ли полезным такой ресурс для обычного пользователя? История интернета содержала интересные веб-ресурсы, которые, к сожалению, сейчас уже не действуют. Webarchive дает возможности погрузиться в прошлое, погулять по просторам того, «другого» Интернета. Также, если вы занимаетесь исследовательской работой, то можете без труда проследить, как изменялся с течением времени дизайн Яндекса или Гугла.

Одна и важных функций этого ресурса состоит в том, что пользователь может найти архив, если сайт в его персональных закладках просто не открывается. Некоторые могут попробовать достать их с помощью кэша поисковиков, однако бывает и так, что ссылки оказываются полностью «мертвыми», тогда только Webarchive может справиться с поставленной задачей.

Во-вторых, данный ресурс очень важен для создателей, разработчиков и держателей сайтов. Если по разным причинам резервное копирование не осуществлялось, не работали или люди просто забывали делать это, то единственным верным способом восстановить все утраченные данные можно только используя архив веб сайтов. Можно также и очистить ссылки от привязи к web.archive.org, чтобы сделать их непосредственными и прямыми только для ресурса.

В-третьих, web.archive.org может помочь в поисках уникального контента. Это актуально для тех, кто:

занимается разработкой дизайна сайтов, однако находится в творческом кризисе;

не занимается профессионально дизайном сайтов, но этого требует случай;

желает создать сайт и не хочет тратиться на дизайнеров (заимствование внешнего вида у других, часто не работающих, ресурсов).

Архив сайта – помощник в любой ситуации

Работа с таким ресурсом может вестись и для того, чтобы найти подходящие статьи и материалы для собственного сайта. Конечно, заниматься плагиатом не рекомендуется, поэтому прежде чем размещать информацию на своем ресурсе, стоит проверить данные на уникальность и, при необходимости, исправить их.

Многие спросят, а с какого же времени ведет свою историю архив? Он работает уже 18 лет – с 1996 года. В то время даже создатели проекта были настроены скептически, ведь задача казалась невыполнимой, даже учитывая тот факт, что электронных ресурсов тогда было в несколько раз меньше. В самом начале архивирование сайтов происходило лишь изредка, однако с годами, по мере того, как возрастала мощность архива, копирование происходило намного чаще.

Интересен факт, что само хранилище занесло себя в базу данных лишь спустя год.

Что бы проверить историю сайта заходим по адресу http://archive.org/web/web.php и вбиваем в поисковую строку адрес интересующего вас сайта.

На этой таблице наглядно отображено, когда и сколько раз робот веб архива делал записи о домене seooki.ua. Кликнув по одной из первых дат записей, вы сможете увидеть как выглядел наш сайт пару лет назад :)

Еще одна полезная функция веб архива — это возможность сохранить страницу по её адресу. Для этого в специальной форме вводим необходимый вам url адрес и через несколько секунд вы сможете её просматривать на сайте веб архива.

Эта функция будет полезна, если вам нужно изучить информацию на странице, которая может быть удалена или отредактирована, а так же если вы просто хотите “увековечить” данную статью и иметь возможность просмотреть страницу через несколько десятилетий.

Для чего нужен веб архив сайтов

Другими словами этот веб архив сайтов, сохраняет в своём хранилище не только исправно функционирующие сайты, но и те, которые, когда то, по разным причинам, прекратили своё существование в интернет пространстве.

Этот мега монстр web.archive.org, выполняет очень полезную работу, благодаря которой, многие веб мастера, могут восстановить свой веб сайт, в случае если, по каким то причинам, забыли сделать БЭКАП сайта.

Этот веб архив, используют и для заработка, получая контент с закрытых сайтов, который со временем, пропал из индекса поисковых систем, стал уникальным и отличным товаром для продажи на биржах купли продажи статей.

Весь контент сохраняется в текстовом формате, со всеми ссылками, картинками и оформлением css.

Этот веб архив сайтов, сохраняет копии интернет ресурсов не один раз, а на разных этапах, поэтому, можно проследить развитие сайта, как он выглядел и проверить историю домена перед регистрацией (ну вдруг он торговал ссылками и попал под АГС фильтр).

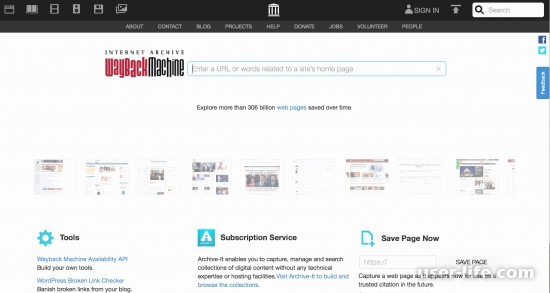

Перейдя на Главную страницу web.archive.org, перед Вами будут строка поиска, в которую нужно ввести название домена и нажать на кнопку BROWSE HISTORY.

И через несколько секунд, получите отчёт в виде календаря по месяцам Цифры в кружочке означают, что этим числом датирована дата создания копии сайта. Нажмите на цифру в кружочке и увидите как выглядел сайт в ту дату.

А чтобы скачать архив сайта, я рассказывал в статье как восстановить сайт, в которой в Способе № 3, рассказал об этом со скриншотами. А в видео уроке, (в конце статьи), Вы можете узнать, как найти и скачать архив с сайтом на свой компьютер.

Если Вы хотите, чтобы контент Вашего сайта, не попадал в веб архив, то в файле robots.txt, Вы можете закрыть доступ к для робота с web.archive, Вашего сайта.

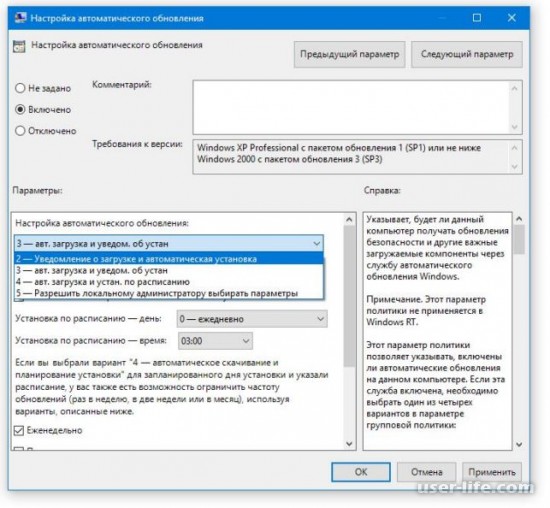

Для этого, нужно добавить в данный файл строчки:

User-agent: ia_archiver

Disallow: /

Сейчас на все про все (включая аудио, видео и отсканированные книги) у этой некоммерческой организации задействовано дисковое пространство чудовищных размеров, измеряемое десяткой с пятнадцатью нулями байт. Сайт имеет зеркала в различных дата центрах, а сам проект с недавних пор получил официальный статус библиотеки. Если рассматривать только архив страниц сайтов, то их уже там насчитывается около ста миллиардов (тут учитываются все слепки страниц когда-либо снятые и сохраненные).

На главной странице доступен не только архив страниц интернета Wayback Machine, но и архивы различных кинохроник, телепередач, аудио записей и отсканированных в различных библиотеках книг:

Но нас интересует именно область WEB с логотипом Wayback Machine. В расположенную там форму можно ввести URL или доменное имя интересующего вас сайта, чтобы попасть на страницу с календарем:

Из приведенного примера видно, что наш сайт был впервые архивирован 22 июля 2010 года. За прошедший период было создано 11 архивных копий сайта, каждую из которым можно будет посмотреть и потрогать руками (осуществляя переходы по внутренним ссылкам).

Открытие мертвых ссылок и условия попадания сайта в archive.org

В календаре голубыми кружочками отмечены даты, в которые был создан слепок (вебархив) данного сайта. Естественно, что моменты снятия слепка никак не будут коррелироваться с производимыми на вашем ресурсе изменениями, и их время Webarchive определяет строго исходя из своих внутренних алгоритмов и таймеров.

Поэтому использовать архив интернета, как инструмент для открытия временно недоступных сайтов, наверное, не всегда будет резонным. Для этого у Яндекса имеется возможность просмотра архивной копии документа:

Да, и в Google можно всегда посмотреть сохраненную копию веб-страницы:

Данный же онлайн сервис понадобится в особо тяжелых случаях, когда искомая страница уже не существует и вряд ли уже будет существовать в реальном интернете, но зато она по прежнему будет доступна в машине времени.

Правда, тут должно быть соблюдено несколько условий того, чтобы сайт попал в archive.org:

Он не должен содержать в своем файле robots.txt запрет для его индексации роботом с web.archive.org. Такой запрет, обычно выглядит так:

User-agent: ia_archiver

Disallow: /

Некоторые сайты Вебархив по каким-либо причинам банально не нашел. Вероятность попадания ресурса в базу повышается, если он будет добавлен в каталог Dmoz или же если на него будут проставлены ссылки с других популярных ресурсов, которые в Webarchive уже находятся. В общем то, даже простой запрос через форму на главной странице этого сервиса может послужить толчком к привлечению внимания этого архиватора к вашему ресурсу.

Как найти нужный веб-архив и восстановить сайт без бекапа

По архивам можно перемещаться и с помощью временной шкалы расположенной вверху страницы, где вертикальными черными черточками отмечены имеющиеся для этого сайта слепки. Иногда, веб-архивы могут быть битыми, тогда придется открыть ближайший к нему слепок.

Щелкнув по голубому кружочку мы можем увидеть ссылки на несколько архивов, отличающихся временем их снятия.

Возможно, что это делается во избежании потери данных за счет неизбежной порчи жестких дисков в хранилищах. Перейдя к просмотру одного из веб-архивов, вы увидите копию своего (в данном примере моего) сайта с работающими внутренними ссылками и подключенным стилевым оформлением.

Однако, просто так скопировать текст этой страницы к себе на сайт взамен утерянной не получится. Почему? Да потому что путешествие внутри сайта из прошлого будет возможно лишь в случае замены всех внутренних ссылок на те, что генерит Webarchive (в противном случае вас перебросило бы на современную версию ресурса).

Выглядят эти ссылки примерно так:

http://web.archive.org/web/20110412104838/http://user-life.com/article/170951/2011-04-08/apple-namekaet-o-patente-vtorichnogo-displeja-dlja-iphone

Понятно, что можно будет вручную отсечь вступительную часть ссылок (http://web.archive.org/web/20110412104838/), получив таким образом рабочий вариант. Можно этот процесс даже автоматизировать с помощью инструмента поиска и замены редактора Notepad, но еще проще будет воспользоваться встроенной в этот сервис возможностью замены внутренних ссылок на оригинальные.

Для этого копируете адрес страницы с нужным слепком вашего сайта (из адресной строки браузера — начинается с http://web.archive.org/). Он будет иметь примерно такой вид:

http://web.archive.org/web/20110412104838/web/user-life.com/article

И вставляете в него конструкцию «id_» в конце даты (20111013120145), чтобы получилось так:

http://web.archive.org/web/20110412104838id_/http://user-life.com/

Теперь измененный адрес обратно возвращаете в адресную строку браузера и жмете на Enter. После этого страница c архивом вашего сайта обновится и все внутренние ссылки станут прямыми. Можно будет копировать текст статьи из исходного кода вебархива.

Понятно, что восстановление таким образом огромного сайта займет чудовищное количество времени, но когда другого варианта нет, то и такой покажется манной небесной. К тому же, страдают невозвратной потерей контента обычно только начинающие вебмастера, у которых этого самого контента было мало, а более-менее опытные сайтовладельцы, уж не раз обжигавшиеся на подобных вещах, делают бэкапы файлов и базы по пять раз на дню.

Если вы захотите увидеть все страницы вашего (или чужого) сайта, которые содержатся в недрах этого мастодонта, то вам нужно будет вставить в адресную строку браузера следующий адрес и нажать Enter:

http://wayback.archive.org/web/*/user-life.com*

Вместо моего домена можно использовать свой. На открывшейся странице вы получите возможность наложить фильтр в предназначенной для этого форме:

Как вытянуть из Webarchive уникальный контент для сайта

Описанный ниже способ лично я не использовал, но чисто теоретически все должно работать. Принцип метода состоит в том, что каждый день умирают и никогда не возрождаются десятки сайтов.

Причин этому может быть много и большинство из почивших в бозе ресурсов никакой особой ценности в плане контента никогда и не представляли. Но из всякого правила бывают исключения и нужно будет всего-навсего отделить зерна от плевел. Главное чтобы исчезнувшие сайты с более-менее удобоваримым контентом были бы представлены в Web Archive, хотя бы одной копией.

Т.к. после смерти контент этих сайтов постепенно выпадет из индекса поисковых систем, то взяв его из интернет-архива вы, по идее, станете его законным владельцем и первоисточником для поисковых систем. Но кроме проблемы уникальности текстов, существует проблема их отыскания.

Значит нам нужен список сайтов, которые скоро умрут или уже померли. Автор метода предлагает скачать с сайта регистратора доменных имен Nic.ru список освобождающихся или уже освободившихся доменов.

Что примечательно, в последней колонке этого списка (его можно открыть в Excel) будет отображаться количество архивов, созданных для каждого сайта в Web Archive (правда, проверить наличие домена в веб-архиве можно и в ряде онлайн сервисов, например, на этом или на этом).

Ну, а дальше просматриваем содержимое сайтов, которое сохранил Web Archive и пытаемся найти что-то стоящее. Потом проверяем уникальность этих материалов (ссылку приводил чуть выше) и в случае удачи публикуем их на своем ресурсе, либо продаем в какой-нибудь бирже контента.

Практическое использование веб-архива

В первую очередь данный архив интернета полезен тем, кто по каким-либо причинам не сделал копию собственного ресурса. В таком случае при непредвиденных обстоятельствах сохранится возможность восстановить свой сайт только с помощью веб-архива. Для этого необходимо будет отменить все ссылки от привязки к веб-архиву и сделать их прямыми для вашего сайта.

Также web.archive.org может быть полезен тем, кто ищет некий уникальный контент. Поскольку за время существования интернета «умерло» великое множество разнообразных страниц, на просторах архива можно будет отыскать действительно полезную информацию, которая с легкостью сможет пройти проверку на уникальность. Основная проблема заключается в том, что отыскать нужный контент в огромных «дебрях» archive.org довольно трудно. Необходимо четко представлять, что и где искать.

Очевидно, что через веб архив сайтов возможно пройти по «мертвым» ссылкам, даже если они уже исчезли из кеша Гугла или Яндекса.

Ну и для любителей поностальгировать существует возможность узнать, как менялась история любого сайта, который существовал за время работы web.archive.org. Ведь archive.org – это своеобразная «машина времени», в которой доступна история всего интернета. Своеобразный взгляд в прошлое.

Как на archive.org посмотреть историю сайта

Благодаря веб-сканеру, в библиотеке веб-архива, хранится большая часть интернет-площадок со всеми их страницами. Также, он сохраняет все его изменения. Таким образом, можно просмотреть историю любого веб-ресурса, даже если его уже давно не существует.

Для этого, необходимо зайти на https://web.archive.org/ и в поисковой строке ввести адрес веб-ресурса.

После, некоторого времени, веб-архив выдаст календарь с датами изменений данной страницы и информацию о его создании и количестве изменений за весь период.

Согласно полученной информации, можно узнать, что главная страница нашего сайта была впервые найдена сервисом 24 мая 2014 года. И, с этого времени, по сегодняшний день, ее копия сохранялась 38 раз. Даты изменений на странице отмечены на календаре голубым цветом. Для того, чтобы посмотреть историю изменений и увидеть как выглядел определенный участок веб-ресурса в интересующий вас день, следует выбрать нужный период в ленте с предыдущими годами, и дату в календаре из тех, что предлагает сервис.

Через мгновение, веб-архив откроет запрашиваемую версию на своей платформе, где можно увидеть как выглядел наш сайт в самом первоначальном виде.

Далее, с помощью календаря со стрелками, в самом верху экрана, можно перелистывать страницы, по хронологии их изменений, чтобы отследить, как изменялся внешний вид и их содержание.

Таким образом, можно нырнуть в прошлое и увидеть все его перемены, которые с ним происходили за все время его существования.

Почему вы можете не узнать на Webarchive, как выглядел сайт раньше

Случается такое, что веб-площадка не может быть найден с помощью сервиса Internet Archive Wayback Machine. И происходит это по нескольким причинам:

правообладатель решил удалить все копии;

веб-ресурс закрыли, согласно закону о защите интеллектуальной собственности;

в корневую директорию интернет-площадки, внесен запрет через файл robots.txt

Для того, чтобы сайт в любой момент был в веб-архиве, рекомендуется принимать меры предосторожности и самостоятельно сохранять его в библиотеке Webarchive. Для этого в разделе Save Page Now введите адрес веб-ресурса, который нужно заархивировать, нажмите кнопку Save Page.

Таким образом, для безопасности и сохранности всей информации, необходимо такую процедуру повторять с каждым изменением. Это даст 100% гарантию сохранения ваших страниц на долгое время.

Как недействующий сайт восстановить из веб-архива

Бывают разные ситуации, когда браузер выдает, что такого-то веб-сервиса больше нет. Но данные нужно извлечь. Поможет Webarchive.

И для этого существует два варианта. Первый подходит для старых площадок небольшого размера и хорошо проиндексированных. Просто извлеките данные нужной версии. Далее просматривается код страницы и дошлифовываются вручную ссылки. Процесс несколько трудозатратный по времени и действиям. Поэтому существует другой, более оптимальный способ.

Второй вариант идеален для тех, кто хочет сэкономить время и решить вопрос скачивания, максимально быстро и легко. Для этого нужно открыть сервис восстановления сайта из Webarchive – RoboTools. Ввести доменное имя интересующего портала и указать дату сохраненной его версии. Через некоторое время, задача будет выполнена в полном объеме, с наполнением всех страниц.

Как найти контент из веб-архива

Webarchive является замечательным источником для наполнения полноценными текстами веб-ресурсов. Есть множество площадок, которые по ряду причин прекратили свое существование, но содержат в себе полезную и нужную информацию. Которая не попадает в индексы поисковых систем, и по сути есть неповторяющейся.

Так, существует свободные домены, которые хранят много интересного материала. Все что нужно, это найти подходящее содержание, и проверить его уникальность. Это очень выгодно, как финансово – ведь не нужно будет оплачивать работу авторов, так и по времени – ведь весь контент уже написан.

Как сделать так, чтобы сайт не попал в библиотеку веб-архива

Случаются такие ситуации, когда владелец интернет-площадки дорожит информацией, размещенной на его портале, и он не хочет, чтобы она стала доступной широкому кругу. В таких ситуациях есть один простой выход – в файле robots.txt, прописать запретную директиву для Webarchive. После этого изменения в настройках, веб-машина больше не будет создавать копии такого веб-ресурса.

Как уже отмечалось выше, веб-архив — это сайт, который предоставляет определенного рода услуги по поиску в истории. Чтобы использовать проект, необходимо:

Зайти на специализированный ресурс (к примеру, web.archive.org).

В специальное поле внести информацию к поиску. Это может быть доменное имя или ключевое слово.

Получить соответствующие результаты. Это будет один или несколько сайтов, к каждому из которых имеется фиксированная дата обхода.

Нажатием по дате перейти на соответствующий ресурс и использовать информацию в личных целях.

О специализированных сайтах для поиска исторического фиксирования проектов поговорим далее, поэтому оставайтесь с нами.

Проекты, предоставляющие историю сайта

Peeep.us в действии

Сегодня существует несколько проектов, которые предоставляют сервисные услуги по отысканию сохраненных копий. Вот некоторые из них:

Самым популярным и востребованным у пользователей является web.archive.org. Представленный сайт считается наиболее старым на просторах интернета, создание датируется 1996 годом. Сервис проводит автоматический и ручной сбор данных, а вся информация размещается на огромных заграничных серверах.

Вторым по популярности сайтом считается peeep.us. Ресурс весьма интересен, ведь его можно использовать для сохранения копии информационного потока, который доступен только вам. Заметим, что проект работает со всеми доменными именами и расширяет границы использования веб-архивов. Что касается полноты информации, то представленный сайт не сохраняет картинки и фреймы. С 2015 года также внесен в список запрещенных на территории России.

Аналогичным проектом, который описывали выше, является archive.is. К отличиям можно отнести полноту сбора информации, а также возможности сохранения страниц из социальных сетей. Поэтому если вы утеряли пост или интересную информацию, можно выполнить поиск через веб-архив.

Возможности сохраненной истории

Теперь каждый знает, что такое веб-архив, какие сайты предоставляют услуги сохранения копий проектов. Но многие до сих пор не понимают, как использовать представленную информацию. Возможности архивных данных выражаются в следующем:

Выбор доменного имени. Не секрет, что многие веб-мастера используют уже прокачанные домены. Стоит понимать, что опытные юзеры отслеживают не только целевые параметры, но и историю предыдущего использования. Каждый пользователь сети желает знать, что приобретает: имелись ли ранее запреты или санкции, не попадал ли проект под фильтры.

Восстановление сайта из архивов. Иногда случается беда, которая ставит под угрозу существование собственного проекта. Отсутствие своевременных бэкапов в профиле хостинга и случайная ошибка может привести к трагедии. Если подобное произошло, не стоит расстраиваться, ведь можно воспользоваться веб-архивом. О процессе восстановления поговорим ниже.

Поиск уникального контента. Ежедневно на просторах интернета умирают сайты, которые наполнены контентом. Это случается с особым постоянством, из-за чего теряется огромный поток информации. Со временем такие страницы выпадают из индекса, и находчивый веб-мастер может позаимствовать информацию на личный проект. Конечно, существует проблема с поиском, но это вторичная забота.

Мы рассмотрели основные возможности, которые предоставляют веб-архивы, самое время перейти к более подробному изучению отдельных элементов.

Восстанавливаем сайт из веб-архива

Никто не застрахован от проблем с сайтами. Большинство их них решается с использованием бэкапов. Но что делать, если сохраненной копии на сервере хостинга нет? Воспользоваться веб-архивом. Для этого следует:

Зайти на специализированный ресурс, о которых мы говорили ранее.

Внести собственное доменное имя в строку поиска и открыть проект в новом окне.

Выбрать наиболее удачный снимок, который располагается ближе к проблемной дате и имеет полноценный вид.

Исправить внутренние ссылки на прямые. Для этого используем ссылку «http://web.archive.org/web/любой_порядковый_номер_id_/Название сайта».

Скопировать потерянную информацию или данные дизайна, которые будут применены для восстановления.

Заметим, что процесс несколько утомительный, с учетом скорости работы архива. Поэтому рекомендуем владельцам больших веб-ресурсов чаще выполнять бэкапы, что сохранит время и нервы.

Ищем уникальный контент для собственного сайта

Уникальный контент из веб-архива

Некоторые веб-мастера используют интересный способ получения нового, никому не нужного контента. Ежедневно сотни сайтов уходят в небытие, а вместе с ними теряется информация. Чтобы стать владельцем контента, нужно выполнить следующее:

Внести URL

https://www.nic.ru/auction/forbuyer/download_list.shtml#buying в строку поиска.

На сайте аукциона доменных имен скачать файлы с именем ru.

Открыть полученные файлы с использованием excel и начать отбор по параметру наличия проектной информации.

Найденные в списке проекты ввести на странице поиска веб-архива.

Открыть снимок и получить доступ к информационному потоку.

Когда и почему сайт попадает в архив сайтов Интернета

После создания сайта он может попасть в Archive.org либо сразу, либо через некоторое время, а бывает, что даже действующего сайта там нет. Условия попадания вашего Интернет-ресурса в Архив следующие:

отсутствие в файле robots.txt команды на запрет его индексации

(User-agent:ia_archiver

Disallow: /);

наличие на ресурсе ссылок на поисковые системы или популярные сервисы;

переход на сайт с помощью поисковиков других пользователей.

Как можно использовать архиватором

В Archive.org сохраняются:

текстовые материалы;

аудиофайлы;

видеофайлы;

фото и картинки;

ссылки.

Архив позволяет:

Изучить всю историю своего сайта. Если информация на нем периодически обновляется и сайт содержит десятки страниц, порой бывает сложно найти какую-либо информацию. Здесь как раз архив сайтов Интернета придет на помощь.

Восстановить сам сайт или некоторые его страницы, если вы не делали резервные копии.

Найти уникальный контент для своего сайта. Правда, этот самый контент можно брать только с уже не существующих ресурсов, поскольку то, что представлено на действующих, как известно, не будет уникальным. К тому же, нужно знать адрес сайта, чтобы найти его и взять какую-либо информацию в архиве.

Инструкция по работе с Archive.org

Принцип работы сервиса Archive.org очень прост. Чтобы найти данные о каком-либо сайте, нужно лишь указать его адрес в строке WaybackMachine (Webarchive Machine).

Рассмотрим архив сайта на примере моего блога. Для этого заходим в саму библиотеку и вводим адрес – firelinks.ru. Жмем Enter.

Примечание. Если мы не сразу вставляем адрес, а печатаем, под строкой поиска появляются другие сайты с похожими названиями. Эта функция полезна, например, если вы забыли название разыскиваемого ресурса.

Открывается страница с данными. Под названием сайта видим информацию о том, сколько раз был заархивирован сайт и когда. Как видно, первая архивация произошла 18 июня 2014 года, а последняя – 2 октября 2016. Эти даты никак не связаны с изменениями, происходящим на самом сайте, ибо, когда будет производиться архивация, определяет сам WebArchive.

Чтобы более подробно рассмотреть все изменения или увидеть первоначальный вид сайта, просто выбираем год, а затем нажимаем в календаре число и месяц.

Нажмем на самую старую дату. Система переведет нас в сам блог, где будет виден его первоначальный интерфейс и содержимое. Дизайн я тоже некоторых элементов менял, а вот самые первые статьи сейчас уже затерялись и найти их сразу будет не так-то просто.

Таким образом можно посмотреть все изменения, когда-либо произошедшие в блоге, либо найти нужную информацию.

Как найти уникальный контент с помощью Webarchive Machine

Возможность просмотра архива старых сайтов дает возможность любому человеку использовать данные, которые на нем были, не опасаясь за неуникальность. Дело в том, что после «смерти» сайта его контент уже не проверяется поисковыми системами, а значит, он снова уникален, и остается проблема лишь поиска этих самых сайтов.

Если вы хотите взять контент с вашего старого ресурса или сайта, которым вы пользовались, но который уже не существует, проблем не возникнет, ведь вы наверняка помните адрес. Ну, а если намереваетесь искать среди всех «умерших» сайтов, можно воспользоваться специальными сервисами, где приводятся списки с освободившимися доменами, то есть с адресами сайтов, которых уже нет.

Я открыл один из таких сервисов, скопировал первый домен и вбил в строке WaybackMachine в Archive.org, но никакого результата это не дало. Такая же история повторилась и с четырьмя последующими доменами. Наконец, поиск по шестому адресу открыл информацию о сайте.

То, что Arcgive.org открывает не все «мертвые» сайты, может быть связано с несколькими причинами. Так, возможно, домен был приобретен, но сам сайт так никогда и не был наполнен каким-либо контентом. Именно так дело обстоит с большинством доменных имен, представленных в списках освобождающихся. Еще одна причина – создатель сайта удалил свой ресурс с самого Архива. Такое тоже может быть.И наконец, возможно, сайта вообще не было в Веб Архиве.

Итак, нам удалось все-таки найти «мертвый» сайт, информацию с которого можно считать. Как видим, сайт существует с 1999 года, и за все время по нему сделано 269 архивов.

Мы можем открыть ресурс и взять оттуда информацию. Для этого, как и в случае с действующими сайтами, просто выбираем любую дату. Данное действие откроет главную страницу в том виде, в котором она была к той дате, которую мы выбрали. Если здесь ничего полезного нет, следует проверить и другие даты.

После того, как полезный контент найден, обязательно следует предварительно проверить его на уникальность, поскольку, во-первых, кто-то до вас уже мог его использовать, а во-вторых, возможно, он все еще отслеживается поисковиками.

Как восстановить сайт с помощью Archive.org

Те, кто давно ведут сайты, знают о том, что нужно периодически делать его резервное копирование. А вот те, кто об этом не подумал, могут столкнуться с проблемой утери веб-страниц или потери функциональности целого сайта. В этом случае Архив снова придет на помощь, но, если у вас ресурс с большим количеством страниц, восстановление займет очень много времени. Еще одна проблема, которая может возникнуть, связана с возможностью утери некоторой доли информации или искажением дизайна.

Если вы все же решили восстановить свой сайт с помощью Archive.org, нужно будет проводить операции с каждой страницей, отсюда и трата времени.

Итак, для восстановления сайта нам нужно заменить внутреннюю ссылку страницы на оригинальную. Если мы посмотрим в адресной строке,ссылка будет иметь вид: http://web.archive.org/web/20161002194015/http://firelinks.ru/, то есть информацию с такой страницы нельзя будет просто скопировать.

Чтобы такая возможность появилась, можно просто вручную убирать начало ссылок, но, когда страниц сотни, это становится довольно кропотливым занятием. Поэтому мы будем использовать возможность самого Архива заменять ссылки. Для этого в адресной строке после набора цифр вставляем «id_» и жмем Enter.

Теперь ссылка оригинальная и можно просто копировать тексты, картинки и прочие файлы из исходного кода Архива. Такую же операцию проводим и с другими страницами сайта. Конечно, даже такой вариант займет много времени, но, если нет резервных копий, по-другому восстановить сайт вряд ли получится.

Как удалить сайт с Archive.org

Большинство создателей сайтов хотят, чтобы их ресурс попал в Архив, но бывают и случаи, когда, напротив, нужно сделать так, чтобы он либо не попал туда, либо удалился. Сам InternetArchive предлагает для этого очень простой метод. Нужно лишь задать команду для робота сервиса о том, что сайт не нужно включать в Архив, то есть написать в robots.txt следующее:

User-agent: ia_archiver

Disallow: /

Будет ли полезным такой ресурс для обычного пользователя? История интернета содержала интересные веб-ресурсы, которые, к сожалению, сейчас уже не действуют. Webarchive дает возможности погрузиться в прошлое, погулять по просторам того, «другого» Интернета. Также, если вы занимаетесь исследовательской работой, то можете без труда проследить, как изменялся с течением времени дизайн Яндекса или Гугла.

Одна и важных функций этого ресурса состоит в том, что пользователь может найти архив, если сайт в его персональных закладках просто не открывается. Некоторые могут попробовать достать их с помощью кэша поисковиков, однако бывает и так, что ссылки оказываются полностью «мертвыми», тогда только Webarchive может справиться с поставленной задачей.

Во-вторых, данный ресурс очень важен для создателей, разработчиков и держателей сайтов. Если по разным причинам резервное копирование не осуществлялось, не работали или люди просто забывали делать это, то единственным верным способом восстановить все утраченные данные можно только используя архив веб сайтов. Можно также и очистить ссылки от привязи к web.archive.org, чтобы сделать их непосредственными и прямыми только для ресурса.

В-третьих, web.archive.org может помочь в поисках уникального контента. Это актуально для тех, кто:

занимается разработкой дизайна сайтов, однако находится в творческом кризисе;

не занимается профессионально дизайном сайтов, но этого требует случай;

желает создать сайт и не хочет тратиться на дизайнеров (заимствование внешнего вида у других, часто не работающих, ресурсов).

Архив сайта – помощник в любой ситуации

Работа с таким ресурсом может вестись и для того, чтобы найти подходящие статьи и материалы для собственного сайта. Конечно, заниматься плагиатом не рекомендуется, поэтому прежде чем размещать информацию на своем ресурсе, стоит проверить данные на уникальность и, при необходимости, исправить их.

Многие спросят, а с какого же времени ведет свою историю архив? Он работает уже 18 лет – с 1996 года. В то время даже создатели проекта были настроены скептически, ведь задача казалась невыполнимой, даже учитывая тот факт, что электронных ресурсов тогда было в несколько раз меньше. В самом начале архивирование сайтов происходило лишь изредка, однако с годами, по мере того, как возрастала мощность архива, копирование происходило намного чаще.

Интересен факт, что само хранилище занесло себя в базу данных лишь спустя год.

Что бы проверить историю сайта заходим по адресу http://archive.org/web/web.php и вбиваем в поисковую строку адрес интересующего вас сайта.

На этой таблице наглядно отображено, когда и сколько раз робот веб архива делал записи о домене seooki.ua. Кликнув по одной из первых дат записей, вы сможете увидеть как выглядел наш сайт пару лет назад :)

Еще одна полезная функция веб архива — это возможность сохранить страницу по её адресу. Для этого в специальной форме вводим необходимый вам url адрес и через несколько секунд вы сможете её просматривать на сайте веб архива.

Эта функция будет полезна, если вам нужно изучить информацию на странице, которая может быть удалена или отредактирована, а так же если вы просто хотите “увековечить” данную статью и иметь возможность просмотреть страницу через несколько десятилетий.

Для чего нужен веб архив сайтов

Другими словами этот веб архив сайтов, сохраняет в своём хранилище не только исправно функционирующие сайты, но и те, которые, когда то, по разным причинам, прекратили своё существование в интернет пространстве.

Этот мега монстр web.archive.org, выполняет очень полезную работу, благодаря которой, многие веб мастера, могут восстановить свой веб сайт, в случае если, по каким то причинам, забыли сделать БЭКАП сайта.

Этот веб архив, используют и для заработка, получая контент с закрытых сайтов, который со временем, пропал из индекса поисковых систем, стал уникальным и отличным товаром для продажи на биржах купли продажи статей.

Весь контент сохраняется в текстовом формате, со всеми ссылками, картинками и оформлением css.

Этот веб архив сайтов, сохраняет копии интернет ресурсов не один раз, а на разных этапах, поэтому, можно проследить развитие сайта, как он выглядел и проверить историю домена перед регистрацией (ну вдруг он торговал ссылками и попал под АГС фильтр).

Перейдя на Главную страницу web.archive.org, перед Вами будут строка поиска, в которую нужно ввести название домена и нажать на кнопку BROWSE HISTORY.

И через несколько секунд, получите отчёт в виде календаря по месяцам Цифры в кружочке означают, что этим числом датирована дата создания копии сайта. Нажмите на цифру в кружочке и увидите как выглядел сайт в ту дату.

А чтобы скачать архив сайта, я рассказывал в статье как восстановить сайт, в которой в Способе № 3, рассказал об этом со скриншотами. А в видео уроке, (в конце статьи), Вы можете узнать, как найти и скачать архив с сайтом на свой компьютер.

Если Вы хотите, чтобы контент Вашего сайта, не попадал в веб архив, то в файле robots.txt, Вы можете закрыть доступ к для робота с web.archive, Вашего сайта.

Для этого, нужно добавить в данный файл строчки:

User-agent: ia_archiver

Disallow: /

Сейчас на все про все (включая аудио, видео и отсканированные книги) у этой некоммерческой организации задействовано дисковое пространство чудовищных размеров, измеряемое десяткой с пятнадцатью нулями байт. Сайт имеет зеркала в различных дата центрах, а сам проект с недавних пор получил официальный статус библиотеки. Если рассматривать только архив страниц сайтов, то их уже там насчитывается около ста миллиардов (тут учитываются все слепки страниц когда-либо снятые и сохраненные).

На главной странице доступен не только архив страниц интернета Wayback Machine, но и архивы различных кинохроник, телепередач, аудио записей и отсканированных в различных библиотеках книг:

Но нас интересует именно область WEB с логотипом Wayback Machine. В расположенную там форму можно ввести URL или доменное имя интересующего вас сайта, чтобы попасть на страницу с календарем:

Из приведенного примера видно, что наш сайт был впервые архивирован 22 июля 2010 года. За прошедший период было создано 11 архивных копий сайта, каждую из которым можно будет посмотреть и потрогать руками (осуществляя переходы по внутренним ссылкам).

Открытие мертвых ссылок и условия попадания сайта в archive.org

В календаре голубыми кружочками отмечены даты, в которые был создан слепок (вебархив) данного сайта. Естественно, что моменты снятия слепка никак не будут коррелироваться с производимыми на вашем ресурсе изменениями, и их время Webarchive определяет строго исходя из своих внутренних алгоритмов и таймеров.

Поэтому использовать архив интернета, как инструмент для открытия временно недоступных сайтов, наверное, не всегда будет резонным. Для этого у Яндекса имеется возможность просмотра архивной копии документа:

Да, и в Google можно всегда посмотреть сохраненную копию веб-страницы:

Данный же онлайн сервис понадобится в особо тяжелых случаях, когда искомая страница уже не существует и вряд ли уже будет существовать в реальном интернете, но зато она по прежнему будет доступна в машине времени.

Правда, тут должно быть соблюдено несколько условий того, чтобы сайт попал в archive.org:

Он не должен содержать в своем файле robots.txt запрет для его индексации роботом с web.archive.org. Такой запрет, обычно выглядит так:

User-agent: ia_archiver

Disallow: /

Некоторые сайты Вебархив по каким-либо причинам банально не нашел. Вероятность попадания ресурса в базу повышается, если он будет добавлен в каталог Dmoz или же если на него будут проставлены ссылки с других популярных ресурсов, которые в Webarchive уже находятся. В общем то, даже простой запрос через форму на главной странице этого сервиса может послужить толчком к привлечению внимания этого архиватора к вашему ресурсу.

Как найти нужный веб-архив и восстановить сайт без бекапа

По архивам можно перемещаться и с помощью временной шкалы расположенной вверху страницы, где вертикальными черными черточками отмечены имеющиеся для этого сайта слепки. Иногда, веб-архивы могут быть битыми, тогда придется открыть ближайший к нему слепок.

Щелкнув по голубому кружочку мы можем увидеть ссылки на несколько архивов, отличающихся временем их снятия.

Возможно, что это делается во избежании потери данных за счет неизбежной порчи жестких дисков в хранилищах. Перейдя к просмотру одного из веб-архивов, вы увидите копию своего (в данном примере моего) сайта с работающими внутренними ссылками и подключенным стилевым оформлением.

Однако, просто так скопировать текст этой страницы к себе на сайт взамен утерянной не получится. Почему? Да потому что путешествие внутри сайта из прошлого будет возможно лишь в случае замены всех внутренних ссылок на те, что генерит Webarchive (в противном случае вас перебросило бы на современную версию ресурса).

Выглядят эти ссылки примерно так:

http://web.archive.org/web/20110412104838/http://user-life.com/article/170951/2011-04-08/apple-namekaet-o-patente-vtorichnogo-displeja-dlja-iphone

Понятно, что можно будет вручную отсечь вступительную часть ссылок (http://web.archive.org/web/20110412104838/), получив таким образом рабочий вариант. Можно этот процесс даже автоматизировать с помощью инструмента поиска и замены редактора Notepad, но еще проще будет воспользоваться встроенной в этот сервис возможностью замены внутренних ссылок на оригинальные.

Для этого копируете адрес страницы с нужным слепком вашего сайта (из адресной строки браузера — начинается с http://web.archive.org/). Он будет иметь примерно такой вид:

http://web.archive.org/web/20110412104838/web/user-life.com/article

И вставляете в него конструкцию «id_» в конце даты (20111013120145), чтобы получилось так:

http://web.archive.org/web/20110412104838id_/http://user-life.com/

Теперь измененный адрес обратно возвращаете в адресную строку браузера и жмете на Enter. После этого страница c архивом вашего сайта обновится и все внутренние ссылки станут прямыми. Можно будет копировать текст статьи из исходного кода вебархива.

Понятно, что восстановление таким образом огромного сайта займет чудовищное количество времени, но когда другого варианта нет, то и такой покажется манной небесной. К тому же, страдают невозвратной потерей контента обычно только начинающие вебмастера, у которых этого самого контента было мало, а более-менее опытные сайтовладельцы, уж не раз обжигавшиеся на подобных вещах, делают бэкапы файлов и базы по пять раз на дню.

Если вы захотите увидеть все страницы вашего (или чужого) сайта, которые содержатся в недрах этого мастодонта, то вам нужно будет вставить в адресную строку браузера следующий адрес и нажать Enter:

http://wayback.archive.org/web/*/user-life.com*

Вместо моего домена можно использовать свой. На открывшейся странице вы получите возможность наложить фильтр в предназначенной для этого форме:

Как вытянуть из Webarchive уникальный контент для сайта

Описанный ниже способ лично я не использовал, но чисто теоретически все должно работать. Принцип метода состоит в том, что каждый день умирают и никогда не возрождаются десятки сайтов.

Причин этому может быть много и большинство из почивших в бозе ресурсов никакой особой ценности в плане контента никогда и не представляли. Но из всякого правила бывают исключения и нужно будет всего-навсего отделить зерна от плевел. Главное чтобы исчезнувшие сайты с более-менее удобоваримым контентом были бы представлены в Web Archive, хотя бы одной копией.

Т.к. после смерти контент этих сайтов постепенно выпадет из индекса поисковых систем, то взяв его из интернет-архива вы, по идее, станете его законным владельцем и первоисточником для поисковых систем. Но кроме проблемы уникальности текстов, существует проблема их отыскания.

Значит нам нужен список сайтов, которые скоро умрут или уже померли. Автор метода предлагает скачать с сайта регистратора доменных имен Nic.ru список освобождающихся или уже освободившихся доменов.

Что примечательно, в последней колонке этого списка (его можно открыть в Excel) будет отображаться количество архивов, созданных для каждого сайта в Web Archive (правда, проверить наличие домена в веб-архиве можно и в ряде онлайн сервисов, например, на этом или на этом).

Ну, а дальше просматриваем содержимое сайтов, которое сохранил Web Archive и пытаемся найти что-то стоящее. Потом проверяем уникальность этих материалов (ссылку приводил чуть выше) и в случае удачи публикуем их на своем ресурсе, либо продаем в какой-нибудь бирже контента.

Практическое использование веб-архива

В первую очередь данный архив интернета полезен тем, кто по каким-либо причинам не сделал копию собственного ресурса. В таком случае при непредвиденных обстоятельствах сохранится возможность восстановить свой сайт только с помощью веб-архива. Для этого необходимо будет отменить все ссылки от привязки к веб-архиву и сделать их прямыми для вашего сайта.

Также web.archive.org может быть полезен тем, кто ищет некий уникальный контент. Поскольку за время существования интернета «умерло» великое множество разнообразных страниц, на просторах архива можно будет отыскать действительно полезную информацию, которая с легкостью сможет пройти проверку на уникальность. Основная проблема заключается в том, что отыскать нужный контент в огромных «дебрях» archive.org довольно трудно. Необходимо четко представлять, что и где искать.

Очевидно, что через веб архив сайтов возможно пройти по «мертвым» ссылкам, даже если они уже исчезли из кеша Гугла или Яндекса.

Ну и для любителей поностальгировать существует возможность узнать, как менялась история любого сайта, который существовал за время работы web.archive.org. Ведь archive.org – это своеобразная «машина времени», в которой доступна история всего интернета. Своеобразный взгляд в прошлое.

Как на archive.org посмотреть историю сайта

Благодаря веб-сканеру, в библиотеке веб-архива, хранится большая часть интернет-площадок со всеми их страницами. Также, он сохраняет все его изменения. Таким образом, можно просмотреть историю любого веб-ресурса, даже если его уже давно не существует.

Для этого, необходимо зайти на https://web.archive.org/ и в поисковой строке ввести адрес веб-ресурса.

После, некоторого времени, веб-архив выдаст календарь с датами изменений данной страницы и информацию о его создании и количестве изменений за весь период.

Согласно полученной информации, можно узнать, что главная страница нашего сайта была впервые найдена сервисом 24 мая 2014 года. И, с этого времени, по сегодняшний день, ее копия сохранялась 38 раз. Даты изменений на странице отмечены на календаре голубым цветом. Для того, чтобы посмотреть историю изменений и увидеть как выглядел определенный участок веб-ресурса в интересующий вас день, следует выбрать нужный период в ленте с предыдущими годами, и дату в календаре из тех, что предлагает сервис.

Через мгновение, веб-архив откроет запрашиваемую версию на своей платформе, где можно увидеть как выглядел наш сайт в самом первоначальном виде.

Далее, с помощью календаря со стрелками, в самом верху экрана, можно перелистывать страницы, по хронологии их изменений, чтобы отследить, как изменялся внешний вид и их содержание.

Таким образом, можно нырнуть в прошлое и увидеть все его перемены, которые с ним происходили за все время его существования.

Почему вы можете не узнать на Webarchive, как выглядел сайт раньше

Случается такое, что веб-площадка не может быть найден с помощью сервиса Internet Archive Wayback Machine. И происходит это по нескольким причинам:

правообладатель решил удалить все копии;

веб-ресурс закрыли, согласно закону о защите интеллектуальной собственности;

в корневую директорию интернет-площадки, внесен запрет через файл robots.txt

Для того, чтобы сайт в любой момент был в веб-архиве, рекомендуется принимать меры предосторожности и самостоятельно сохранять его в библиотеке Webarchive. Для этого в разделе Save Page Now введите адрес веб-ресурса, который нужно заархивировать, нажмите кнопку Save Page.

Таким образом, для безопасности и сохранности всей информации, необходимо такую процедуру повторять с каждым изменением. Это даст 100% гарантию сохранения ваших страниц на долгое время.

Как недействующий сайт восстановить из веб-архива

Бывают разные ситуации, когда браузер выдает, что такого-то веб-сервиса больше нет. Но данные нужно извлечь. Поможет Webarchive.

И для этого существует два варианта. Первый подходит для старых площадок небольшого размера и хорошо проиндексированных. Просто извлеките данные нужной версии. Далее просматривается код страницы и дошлифовываются вручную ссылки. Процесс несколько трудозатратный по времени и действиям. Поэтому существует другой, более оптимальный способ.

Второй вариант идеален для тех, кто хочет сэкономить время и решить вопрос скачивания, максимально быстро и легко. Для этого нужно открыть сервис восстановления сайта из Webarchive – RoboTools. Ввести доменное имя интересующего портала и указать дату сохраненной его версии. Через некоторое время, задача будет выполнена в полном объеме, с наполнением всех страниц.

Как найти контент из веб-архива

Webarchive является замечательным источником для наполнения полноценными текстами веб-ресурсов. Есть множество площадок, которые по ряду причин прекратили свое существование, но содержат в себе полезную и нужную информацию. Которая не попадает в индексы поисковых систем, и по сути есть неповторяющейся.

Так, существует свободные домены, которые хранят много интересного материала. Все что нужно, это найти подходящее содержание, и проверить его уникальность. Это очень выгодно, как финансово – ведь не нужно будет оплачивать работу авторов, так и по времени – ведь весь контент уже написан.

Как сделать так, чтобы сайт не попал в библиотеку веб-архива

Случаются такие ситуации, когда владелец интернет-площадки дорожит информацией, размещенной на его портале, и он не хочет, чтобы она стала доступной широкому кругу. В таких ситуациях есть один простой выход – в файле robots.txt, прописать запретную директиву для Webarchive. После этого изменения в настройках, веб-машина больше не будет создавать копии такого веб-ресурса.

Как уже отмечалось выше, веб-архив — это сайт, который предоставляет определенного рода услуги по поиску в истории. Чтобы использовать проект, необходимо:

Зайти на специализированный ресурс (к примеру, web.archive.org).

В специальное поле внести информацию к поиску. Это может быть доменное имя или ключевое слово.

Получить соответствующие результаты. Это будет один или несколько сайтов, к каждому из которых имеется фиксированная дата обхода.

Нажатием по дате перейти на соответствующий ресурс и использовать информацию в личных целях.

О специализированных сайтах для поиска исторического фиксирования проектов поговорим далее, поэтому оставайтесь с нами.

Проекты, предоставляющие историю сайта

Peeep.us в действии

Сегодня существует несколько проектов, которые предоставляют сервисные услуги по отысканию сохраненных копий. Вот некоторые из них:

Самым популярным и востребованным у пользователей является web.archive.org. Представленный сайт считается наиболее старым на просторах интернета, создание датируется 1996 годом. Сервис проводит автоматический и ручной сбор данных, а вся информация размещается на огромных заграничных серверах.

Вторым по популярности сайтом считается peeep.us. Ресурс весьма интересен, ведь его можно использовать для сохранения копии информационного потока, который доступен только вам. Заметим, что проект работает со всеми доменными именами и расширяет границы использования веб-архивов. Что касается полноты информации, то представленный сайт не сохраняет картинки и фреймы. С 2015 года также внесен в список запрещенных на территории России.

Аналогичным проектом, который описывали выше, является archive.is. К отличиям можно отнести полноту сбора информации, а также возможности сохранения страниц из социальных сетей. Поэтому если вы утеряли пост или интересную информацию, можно выполнить поиск через веб-архив.

Возможности сохраненной истории

Теперь каждый знает, что такое веб-архив, какие сайты предоставляют услуги сохранения копий проектов. Но многие до сих пор не понимают, как использовать представленную информацию. Возможности архивных данных выражаются в следующем:

Выбор доменного имени. Не секрет, что многие веб-мастера используют уже прокачанные домены. Стоит понимать, что опытные юзеры отслеживают не только целевые параметры, но и историю предыдущего использования. Каждый пользователь сети желает знать, что приобретает: имелись ли ранее запреты или санкции, не попадал ли проект под фильтры.

Восстановление сайта из архивов. Иногда случается беда, которая ставит под угрозу существование собственного проекта. Отсутствие своевременных бэкапов в профиле хостинга и случайная ошибка может привести к трагедии. Если подобное произошло, не стоит расстраиваться, ведь можно воспользоваться веб-архивом. О процессе восстановления поговорим ниже.

Поиск уникального контента. Ежедневно на просторах интернета умирают сайты, которые наполнены контентом. Это случается с особым постоянством, из-за чего теряется огромный поток информации. Со временем такие страницы выпадают из индекса, и находчивый веб-мастер может позаимствовать информацию на личный проект. Конечно, существует проблема с поиском, но это вторичная забота.

Мы рассмотрели основные возможности, которые предоставляют веб-архивы, самое время перейти к более подробному изучению отдельных элементов.

Восстанавливаем сайт из веб-архива

Никто не застрахован от проблем с сайтами. Большинство их них решается с использованием бэкапов. Но что делать, если сохраненной копии на сервере хостинга нет? Воспользоваться веб-архивом. Для этого следует:

Зайти на специализированный ресурс, о которых мы говорили ранее.

Внести собственное доменное имя в строку поиска и открыть проект в новом окне.

Выбрать наиболее удачный снимок, который располагается ближе к проблемной дате и имеет полноценный вид.

Исправить внутренние ссылки на прямые. Для этого используем ссылку «http://web.archive.org/web/любой_порядковый_номер_id_/Название сайта».

Скопировать потерянную информацию или данные дизайна, которые будут применены для восстановления.

Заметим, что процесс несколько утомительный, с учетом скорости работы архива. Поэтому рекомендуем владельцам больших веб-ресурсов чаще выполнять бэкапы, что сохранит время и нервы.

Ищем уникальный контент для собственного сайта

Уникальный контент из веб-архива

Некоторые веб-мастера используют интересный способ получения нового, никому не нужного контента. Ежедневно сотни сайтов уходят в небытие, а вместе с ними теряется информация. Чтобы стать владельцем контента, нужно выполнить следующее:

Внести URL

https://www.nic.ru/auction/forbuyer/download_list.shtml#buying в строку поиска.

На сайте аукциона доменных имен скачать файлы с именем ru.

Открыть полученные файлы с использованием excel и начать отбор по параметру наличия проектной информации.

Найденные в списке проекты ввести на странице поиска веб-архива.

Открыть снимок и получить доступ к информационному потоку.

Когда и почему сайт попадает в архив сайтов Интернета

После создания сайта он может попасть в Archive.org либо сразу, либо через некоторое время, а бывает, что даже действующего сайта там нет. Условия попадания вашего Интернет-ресурса в Архив следующие:

отсутствие в файле robots.txt команды на запрет его индексации

(User-agent:ia_archiver

Disallow: /);

наличие на ресурсе ссылок на поисковые системы или популярные сервисы;

переход на сайт с помощью поисковиков других пользователей.

Как можно использовать архиватором

В Archive.org сохраняются:

текстовые материалы;

аудиофайлы;

видеофайлы;

фото и картинки;

ссылки.

Архив позволяет:

Изучить всю историю своего сайта. Если информация на нем периодически обновляется и сайт содержит десятки страниц, порой бывает сложно найти какую-либо информацию. Здесь как раз архив сайтов Интернета придет на помощь.

Восстановить сам сайт или некоторые его страницы, если вы не делали резервные копии.

Найти уникальный контент для своего сайта. Правда, этот самый контент можно брать только с уже не существующих ресурсов, поскольку то, что представлено на действующих, как известно, не будет уникальным. К тому же, нужно знать адрес сайта, чтобы найти его и взять какую-либо информацию в архиве.

Инструкция по работе с Archive.org

Принцип работы сервиса Archive.org очень прост. Чтобы найти данные о каком-либо сайте, нужно лишь указать его адрес в строке WaybackMachine (Webarchive Machine).

Рассмотрим архив сайта на примере моего блога. Для этого заходим в саму библиотеку и вводим адрес – firelinks.ru. Жмем Enter.

Примечание. Если мы не сразу вставляем адрес, а печатаем, под строкой поиска появляются другие сайты с похожими названиями. Эта функция полезна, например, если вы забыли название разыскиваемого ресурса.

Открывается страница с данными. Под названием сайта видим информацию о том, сколько раз был заархивирован сайт и когда. Как видно, первая архивация произошла 18 июня 2014 года, а последняя – 2 октября 2016. Эти даты никак не связаны с изменениями, происходящим на самом сайте, ибо, когда будет производиться архивация, определяет сам WebArchive.

Чтобы более подробно рассмотреть все изменения или увидеть первоначальный вид сайта, просто выбираем год, а затем нажимаем в календаре число и месяц.

Нажмем на самую старую дату. Система переведет нас в сам блог, где будет виден его первоначальный интерфейс и содержимое. Дизайн я тоже некоторых элементов менял, а вот самые первые статьи сейчас уже затерялись и найти их сразу будет не так-то просто.

Таким образом можно посмотреть все изменения, когда-либо произошедшие в блоге, либо найти нужную информацию.

Как найти уникальный контент с помощью Webarchive Machine

Возможность просмотра архива старых сайтов дает возможность любому человеку использовать данные, которые на нем были, не опасаясь за неуникальность. Дело в том, что после «смерти» сайта его контент уже не проверяется поисковыми системами, а значит, он снова уникален, и остается проблема лишь поиска этих самых сайтов.

Если вы хотите взять контент с вашего старого ресурса или сайта, которым вы пользовались, но который уже не существует, проблем не возникнет, ведь вы наверняка помните адрес. Ну, а если намереваетесь искать среди всех «умерших» сайтов, можно воспользоваться специальными сервисами, где приводятся списки с освободившимися доменами, то есть с адресами сайтов, которых уже нет.

Я открыл один из таких сервисов, скопировал первый домен и вбил в строке WaybackMachine в Archive.org, но никакого результата это не дало. Такая же история повторилась и с четырьмя последующими доменами. Наконец, поиск по шестому адресу открыл информацию о сайте.

То, что Arcgive.org открывает не все «мертвые» сайты, может быть связано с несколькими причинами. Так, возможно, домен был приобретен, но сам сайт так никогда и не был наполнен каким-либо контентом. Именно так дело обстоит с большинством доменных имен, представленных в списках освобождающихся. Еще одна причина – создатель сайта удалил свой ресурс с самого Архива. Такое тоже может быть.И наконец, возможно, сайта вообще не было в Веб Архиве.

Итак, нам удалось все-таки найти «мертвый» сайт, информацию с которого можно считать. Как видим, сайт существует с 1999 года, и за все время по нему сделано 269 архивов.

Мы можем открыть ресурс и взять оттуда информацию. Для этого, как и в случае с действующими сайтами, просто выбираем любую дату. Данное действие откроет главную страницу в том виде, в котором она была к той дате, которую мы выбрали. Если здесь ничего полезного нет, следует проверить и другие даты.

После того, как полезный контент найден, обязательно следует предварительно проверить его на уникальность, поскольку, во-первых, кто-то до вас уже мог его использовать, а во-вторых, возможно, он все еще отслеживается поисковиками.

Как восстановить сайт с помощью Archive.org

Те, кто давно ведут сайты, знают о том, что нужно периодически делать его резервное копирование. А вот те, кто об этом не подумал, могут столкнуться с проблемой утери веб-страниц или потери функциональности целого сайта. В этом случае Архив снова придет на помощь, но, если у вас ресурс с большим количеством страниц, восстановление займет очень много времени. Еще одна проблема, которая может возникнуть, связана с возможностью утери некоторой доли информации или искажением дизайна.

Если вы все же решили восстановить свой сайт с помощью Archive.org, нужно будет проводить операции с каждой страницей, отсюда и трата времени.

Итак, для восстановления сайта нам нужно заменить внутреннюю ссылку страницы на оригинальную. Если мы посмотрим в адресной строке,ссылка будет иметь вид: http://web.archive.org/web/20161002194015/http://firelinks.ru/, то есть информацию с такой страницы нельзя будет просто скопировать.

Чтобы такая возможность появилась, можно просто вручную убирать начало ссылок, но, когда страниц сотни, это становится довольно кропотливым занятием. Поэтому мы будем использовать возможность самого Архива заменять ссылки. Для этого в адресной строке после набора цифр вставляем «id_» и жмем Enter.

Теперь ссылка оригинальная и можно просто копировать тексты, картинки и прочие файлы из исходного кода Архива. Такую же операцию проводим и с другими страницами сайта. Конечно, даже такой вариант займет много времени, но, если нет резервных копий, по-другому восстановить сайт вряд ли получится.

Как удалить сайт с Archive.org

Большинство создателей сайтов хотят, чтобы их ресурс попал в Архив, но бывают и случаи, когда, напротив, нужно сделать так, чтобы он либо не попал туда, либо удалился. Сам InternetArchive предлагает для этого очень простой метод. Нужно лишь задать команду для робота сервиса о том, что сайт не нужно включать в Архив, то есть написать в robots.txt следующее:

User-agent: ia_archiver

Disallow: /

Рейтинг:

(голосов:1)

Предыдущая статья: Apidog вход Вконтакте с компьютера: plus версия 3.0 отзывы скачать Андроид Апидог ru зайти моя страница Vk

Следующая статья: Программа Free video converter скачать бесплатно на русском

Следующая статья: Программа Free video converter скачать бесплатно на русском

Не пропустите похожие инструкции:

Комментариев пока еще нет. Вы можете стать первым!

Популярное

Авторизация

Добавить комментарий!